11/03/2022

En el vertiginoso mundo de las criptomonedas y la tecnología blockchain, a menudo nos centramos en los protocolos de consenso, las nuevas altcoins o las finanzas descentralizadas (DeFi). Sin embargo, detrás de las aplicaciones más robustas y escalables, se encuentran tecnologías de infraestructura que, aunque menos visibles, son absolutamente cruciales. Una de estas tecnologías es Apache Kafka. Aunque no es una tecnología nativa del ecosistema cripto, su papel como plataforma de streaming de eventos está demostrando ser un componente fundamental para construir la próxima generación de aplicaciones Web3, sirviendo como un puente vital entre el mundo on-chain y los sistemas tradicionales.

¿Qué es Exactamente Apache Kafka y Por Qué es Tan Importante?

Para entender su rol en el ecosistema cripto, primero debemos desglosar qué es Kafka. En esencia, Apache Kafka es una plataforma de código abierto para la transmisión de eventos distribuida. Imagínelo como un sistema nervioso central para los datos de una empresa. Permite que miles de aplicaciones y sistemas envíen y reciban flujos de datos (o "eventos") en tiempo real, de manera ordenada, confiable y a una escala masiva.

Originalmente desarrollado en LinkedIn para manejar su inmenso flujo de datos de actividad, Kafka se ha convertido en un estándar de la industria utilizado por casi todas las grandes empresas tecnológicas del mundo. Sus funciones principales son:

- Publicar y suscribirse a flujos de registros: Permite que diferentes aplicaciones produzcan datos y otras los consuman sin estar directamente conectadas entre sí.

- Almacenar flujos de registros de forma duradera y tolerante a fallos: Los datos no se pierden si un sistema falla; quedan registrados en el orden en que ocurrieron.

- Procesar flujos de registros en tiempo real: Permite analizar, transformar y reaccionar a los datos a medida que llegan, no después de que se hayan almacenado en una base de datos tradicional.

Estas características lo hacen ideal para cualquier escenario que requiera manejar un volumen masivo de datos secuenciales, desde el seguimiento de clics en un sitio web hasta la telemetría de sensores en el Internet de las Cosas (IoT).

El Puente Inesperado: Kafka y el Ecosistema Blockchain

A primera vista, Kafka y Blockchain parecen mundos aparte. Blockchain se basa en la descentralización y la inmutabilidad criptográfica, mientras que Kafka es una pieza de middleware típicamente gestionada de forma centralizada. Sin embargo, es precisamente en esta diferencia donde reside su poder combinado. Las blockchains, especialmente las públicas como Ethereum, pueden ser lentas y costosas para ciertas operaciones de datos a gran escala. Aquí es donde Kafka entra en juego.

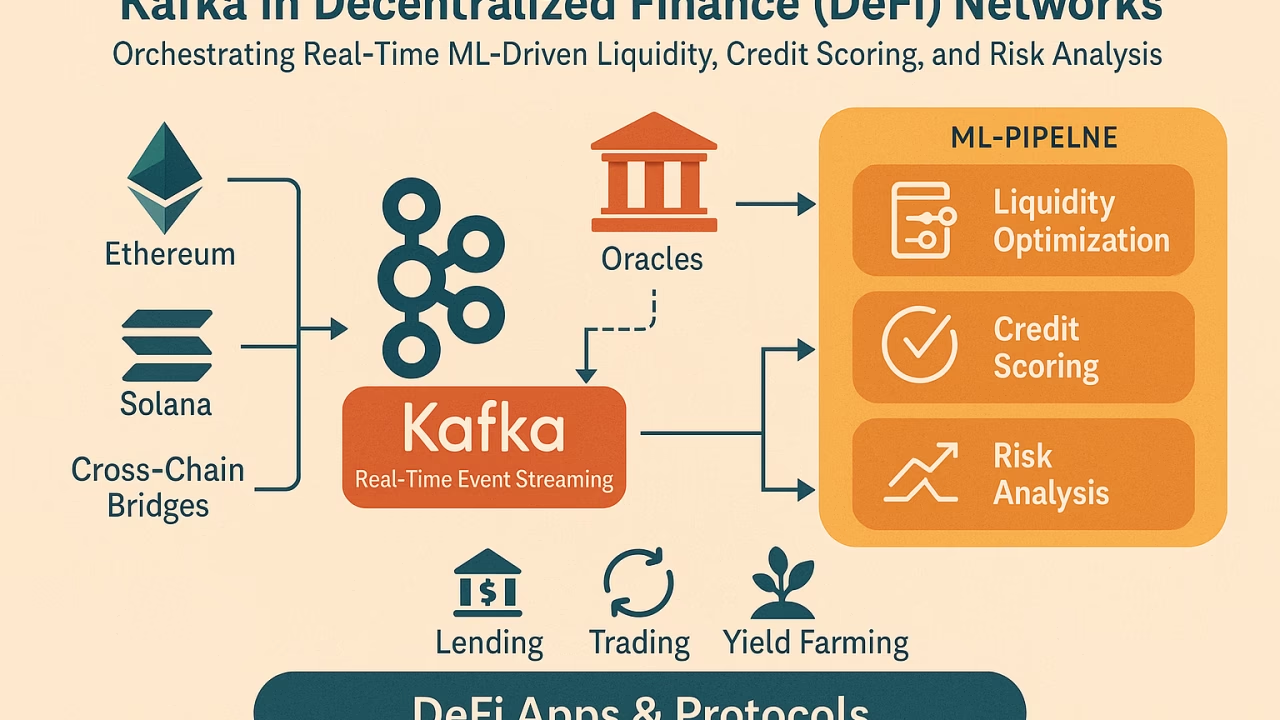

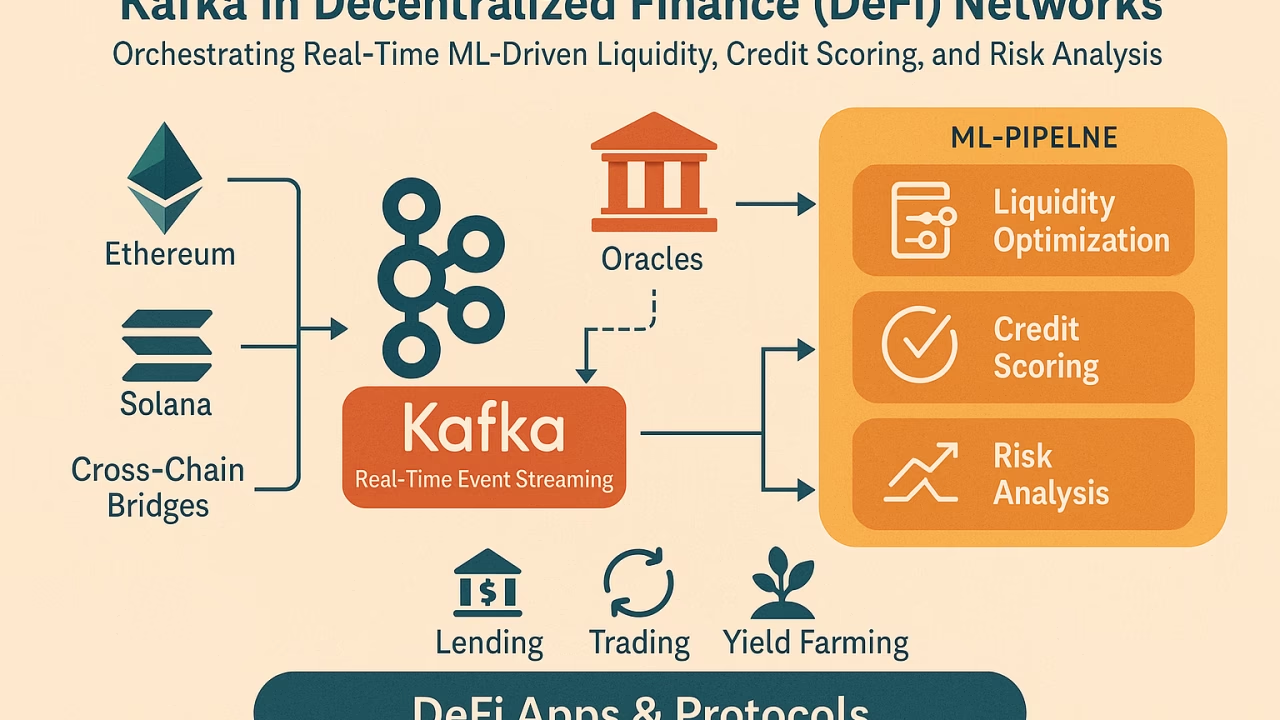

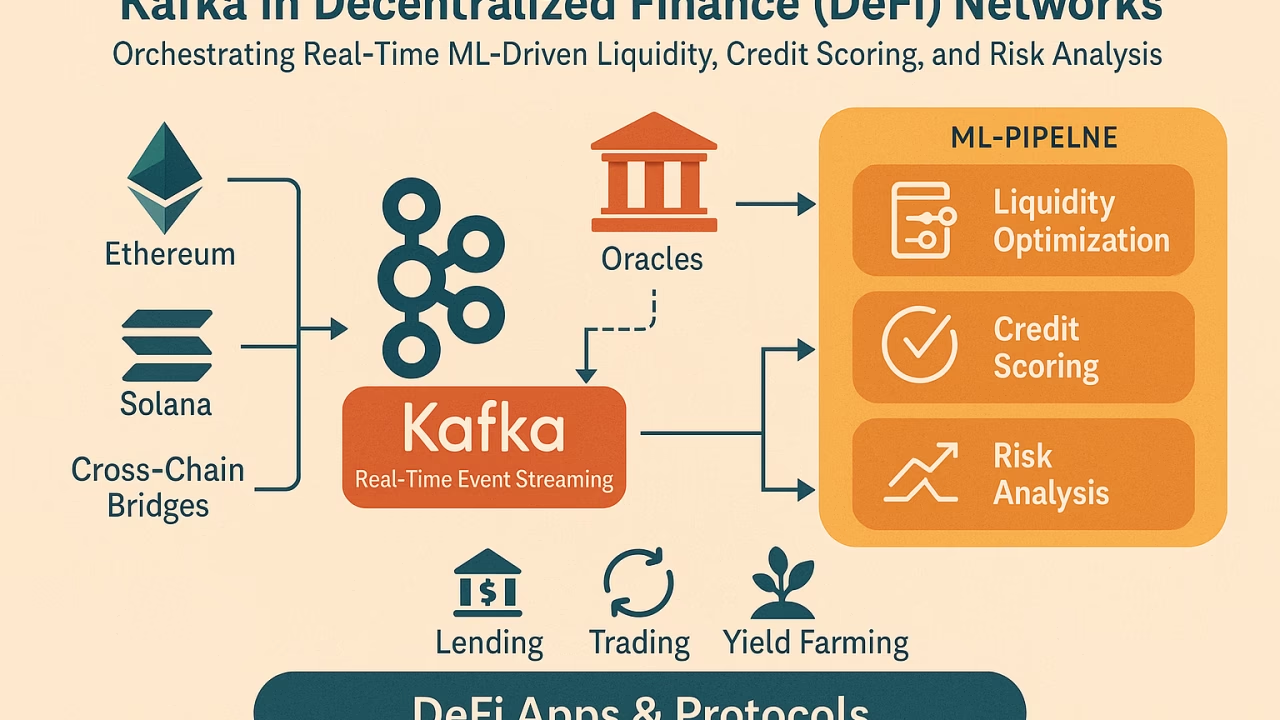

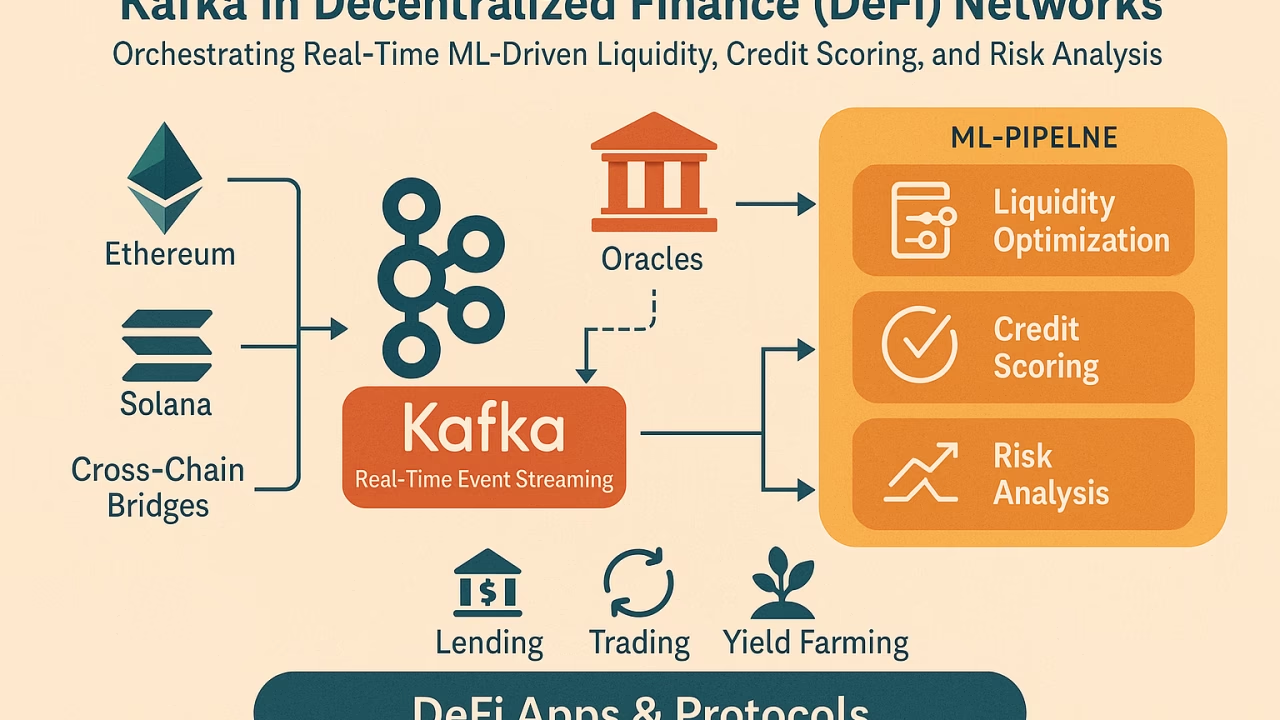

Kafka puede actuar como una capa de ingesta y procesamiento de datos de alto rendimiento que se comunica con una blockchain. Permite desacoplar los sistemas del mundo real (off-chain) de las operaciones en la cadena (on-chain), aportando una escalabilidad y flexibilidad que serían difíciles de lograr únicamente con tecnología blockchain.

Casos de Uso Concretos de Kafka en Cripto y Web3

La sinergia entre Kafka y blockchain no es teórica; ya se está aplicando en soluciones prácticas que potencian el ecosistema:

- Oráculos de Datos Mejorados: Los oráculos son servicios que introducen datos del mundo real en la blockchain. Kafka puede ingestar flujos masivos de datos de mercado (precios de acciones, tasas de interés, etc.) de múltiples fuentes, procesarlos en tiempo real para garantizar su fiabilidad y luego alimentar de forma ordenada y segura a un oráculo on-chain.

- Análisis de Datos On-Chain a Gran Escala: Extraer y analizar datos directamente de un nodo de blockchain puede ser lento e ineficiente. Una arquitectura común es usar un servicio que lea cada nuevo bloque y transacción y los publique como eventos en un tema de Kafka. A partir de ahí, múltiples aplicaciones pueden consumir estos datos para análisis de fraude en tiempo real, monitoreo de redes, creación de dashboards o para alimentar modelos de machine learning.

- Infraestructura para Exchanges de Criptomonedas: Los exchanges centralizados y descentralizados manejan un volumen colosal de órdenes de compra/venta. Kafka es la tecnología perfecta para gestionar el libro de órdenes (order book), la liquidación de operaciones y la difusión de datos de mercado a los usuarios en tiempo real, garantizando que no se pierda ninguna operación y que todo se procese en el orden correcto.

- Comunicación entre Microservicios en dApps Complejas: A medida que las aplicaciones descentralizadas (dApps) se vuelven más complejas, a menudo se construyen utilizando una arquitectura de microservicios. Kafka puede servir como el bus de comunicación asíncrono entre estos servicios, permitiendo que un servicio que interactúa con la blockchain se comunique de manera eficiente con otros servicios que gestionan perfiles de usuario, notificaciones o análisis off-chain.

Kafka vs. Soluciones Nativas: Una Comparativa Clara

Es justo preguntarse por qué no usar simplemente soluciones nativas del ecosistema Web3. Si bien herramientas como The Graph para indexación o Chainlink para oráculos son fundamentales, Kafka resuelve un problema diferente. No compite con ellos, sino que los complementa. Aquí una tabla comparativa para aclarar sus roles:

| Característica | Apache Kafka | Soluciones Nativas (Ej: Oráculos, Indexadores) |

|---|---|---|

| Propósito Principal | Transporte y procesamiento de flujos de datos a gran escala (pipeline de datos). | Garantizar la veracidad y disponibilidad de datos de forma descentralizada en la blockchain. |

| Grado de Centralización | Generalmente centralizado (gestionado por una sola entidad o consorcio). | Altamente descentralizado, basado en consenso criptoeconómico. |

| Velocidad y Latencia | Extremadamente alta velocidad y baja latencia (milisegundos). | Menor velocidad y mayor latencia debido a los mecanismos de consenso. |

| Costo Operativo | Costo de infraestructura de servidores (hardware/cloud). | Costo de gas/transacción y recompensas para los nodos de la red. |

| Integración | Excelente integración con sistemas empresariales tradicionales (Web2). | Optimizado para la integración entre contratos inteligentes (Web3). |

La tabla deja claro que Kafka sobresale en la gestión de datos off-chain y como capa de preparación, mientras que las soluciones nativas se centran en la descentralización y la seguridad on-chain.

El Futuro: ¿Seguirá Kafka Siendo Relevante en 2025 y más allá?

La respuesta es un rotundo sí. A medida que la adopción de la tecnología blockchain crezca, la necesidad de interactuar con el mundo exterior y de manejar datos a una escala que las blockchains actuales no pueden soportar por sí solas se volverá aún más crítica. La escalabilidad sigue siendo uno de los mayores desafíos del ecosistema, y Kafka ofrece una solución probada y robusta para una parte importante de ese problema.

Veremos a Kafka no como un competidor de la tecnología blockchain, sino como un poderoso complemento. Será el motor que impulse las complejas tuberías de datos que alimentarán a las dApps, los protocolos DeFi y los mercados de NFT del futuro, permitiéndoles ofrecer la misma experiencia de usuario fluida y en tiempo real a la que estamos acostumbrados en las aplicaciones Web2, pero con la seguridad y la propiedad que ofrece Web3.

Preguntas Frecuentes (FAQ)

¿Es Kafka una blockchain?

No. Es una confusión común. Kafka no utiliza un mecanismo de consenso distribuido como Prueba de Trabajo (PoW) o Prueba de Participación (PoS) y no es inherentemente inmutable de forma criptográfica. Es un registro de eventos distribuido y ordenado, pero es una tecnología de base de datos y mensajería, no una blockchain.

¿Qué empresas del mundo cripto usan Kafka?

Aunque muchas no lo publicitan explícitamente en su marketing, es una tecnología estándar en la infraestructura de backend de la mayoría de los grandes exchanges de criptomonedas, plataformas de análisis de datos blockchain y proveedores de servicios de infraestructura Web3 debido a su capacidad para manejar enormes volúmenes de datos de mercado y transacciones en tiempo real.

¿Reemplazará Kafka a tecnologías como Chainlink?

No, son herramientas complementarias. Chainlink resuelve el "problema del oráculo" de forma descentralizada, garantizando que los datos introducidos en la cadena sean fiables y resistentes a la manipulación. Kafka puede ser el sistema que recopila, filtra y procesa esos datos a gran escala antes de que sean entregados a la red de Chainlink para su validación y puesta on-chain.

Si quieres conocer otros artículos parecidos a Apache Kafka: El Motor Oculto del Futuro de Web3 puedes visitar la categoría Tecnología.